Solutions Summary

-

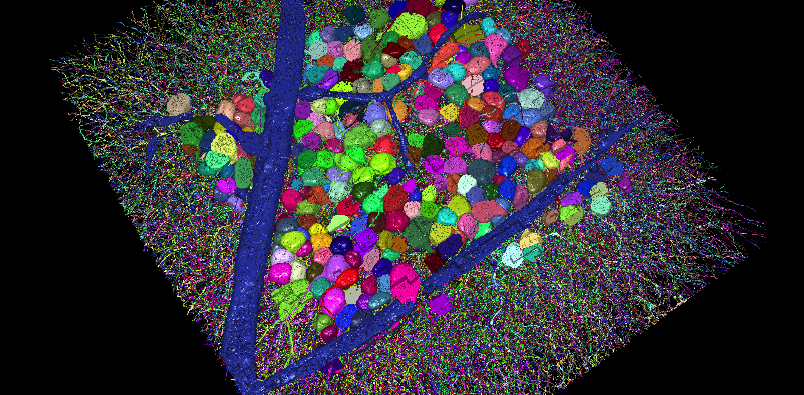

To remedy the cost of memory, I downsample both images and segmentation by a factor of 4 on each dimension to retain some detail. I am only looking for an approximation of the final annotation.

-

Using a combination of asyncio and multiprocessing, I can set the transfer speed of the data gathered through the Eyewire API.

-

After gathering the images, I merge them all into 3D numpy arrays and compress them using the lzma compression library.

-

I remove all zebrafish cells from the data. Eyewire is already developing an agent for this called MSTY.

-

I use my secondary laptop with lots of disk space to help preprocess some of the data.

Bayesian Deep Learning

Bayesian deep learning is a new method of deep learning that deals with the problem of uncertainty. Take a model that tries to classify dogs and cats. What would the model output if it came across this image?

Ideally, there would be a 3rd category that has a label of neither dog nor cat, but adding that label would cost additional data collection. The solution is for the model to output both the classification and an uncertainty value. We can train the model with a loss function that penalizes uncertainty (u) by adding log(u) to the loss function when the original prediction is adjusted for u.

In the case of binary classification, our output (ŷ) is within the range (0,1), and our uncertainty (u) is within the range [1, inf). Our equations are given as follows:

Probability of output given ŷ, u

Loss of output given ŷ, u, and ground truth (y)

![]()

Where σ is the sigmoid function

The gradients of the loss function for backpropagation are as follows:

The result of these equations is that as uncertainty increases, P(ŷ, u) approaches 0.5 and cancels out the logit output ŷ. The sigmoid function is a very sensitive function, making inputs just outside 0 approach either a 0 or 1 probability. Therefore, learning an uncertainty term allows the model to make a guess without being penalized too heavily. We can also derive insight from the uncertainty term itself.

The uncertainty term can even further be used to set a «maybe» threshold. If the uncertainty is higher than a certain value, it gets assigned a maybe label, which would be the exact scenario we want from the merged dog and cat image. This creates an artificial 3rd label that doesn’t require extra data specifically for that label.

Публикации [ править ]

- Ким, Джинсоп С; Грин, Мэтью Дж; Златески, Александар; Ли, Кисук; Ричардсон, Марк; Турага, Шринивас К.; Пуркаро, Майкл; Балкам, Мэтью; Робинсон, Эми; Бехабади, Бардиа Ф; Кампос, Майкл; Денк, Винфрид; Сын, Х. Себастьян (2014). «Пространственно-временная разводка поддерживает избирательность направления в сетчатке» . Природа . 509 (7500): 331–336. Bibcode : 2014Natur.509..331. . DOI : 10,1038 / природа13240 . PMC 4074887 . PMID 24805243 .

- Грин, Мэтью Дж; Ким, Джинсоп С; Сын, Х. Себастьян (2016). «Аналогичная конвергенция устойчивых и переходных входов в параллельных путях включения и выключения для вычисления движения сетчатки» . Отчеты по ячейкам . 14 (8): 1892–900. DOI : 10.1016 / j.celrep.2016.02.001 . PMC 6404534 . PMID 26904938 .

- Тинати, Рамине; Лучак-Рош, Маркус; Симперл, Елена; Холл, Венди (2017). «Исследование мотивации игроков в Eyewire, геймифицированном гражданском научном проекте» . Компьютеры в поведении человека . 73 : 527–40. DOI : 10.1016 / j.chb.2016.12.074 .

POST oauth2/1.0/exchange

Returns an access code given an auth code. One time use, the auth code is invalidated.

Request

| Name | Description |

|---|---|

| auth_code | auth code returned by the end user to the redirect_uri |

| secret | client secret |

| redirect_uri | client redirect_uri |

| client_id | client id |

| grant_type | always ‘authorization_code’ |

Response 200

| Name | Description |

|---|---|

| access_token | token used to access parts of the api |

| token_type | the string «bearer» in accordance with the Oauth2 spec |

Error Responses

- 400 — invalid_client, the client application information is invalid

- 400 — invalid_grant, the auth code is invalid, possibly already used.

- 400 — unsupported_grant_type, the grant_type is not authorization_code

Example Response

{

"access_token": "78q3ja8y",

"token_type": "bearer"

}

The task API is the one you’ll be interacting with the most. It’s used to assign tasks and submit player evaluations of them called validations. Each task consists of a set of image data and a seed piece. Each validation consists of the seed piece plus any segments the player selects. We aggregate submitted validations to form a consensus opinion of the actual structure of the cell.

Credits

- Eyewire: Providing the resources for this project

- Amy Sterling: Connecting me to the development team, and for supporting me in building this project

- Chris Jordan: Creating the OAuth API authentication for me to connect to the API without using a logged in browser and providing API documentation support

- Doug Bland: Moral support

- KrzysztofKruk: Providing the Cell Registry

- Princeton University — Seung Laboratory: Maintaining Eyewire to be an awesome citizen science game and for developers to work on my requests

- MIT: Building Eyewire

- Professor Yu-Xiang Wang: Providing insight into segmentation and how to create a model for the purposes of propagating a seed

![]()

The Final Dataset

After downsampling all the images/segmentations and removing tasks containing an empty seed, we are left with ~1.7 million data points across 56,326 3D images. Images are grayscale images of size 64x64x64, stored as lzma compressed 1D uint8 binary files. Segmentation files are lzma compressed 1D uint16 binary files. We also have two additional files used to store the data on individual tasks, task_data.json, and task_vol.json. These files are used to quickly get task data without needing to access the API, significantly speeding up training.

After splitting up the dataset, ~1.5 million tasks are used for training, and ~145,700 tasks are used as a testing dataset. When training, we randomly sample a quarter of the training dataset because it takes too much time (128 hrs) to train on 1.5 million tasks.

task_vol.json

This file is a json object containing the mapping of tasks to volume IDs to easily index the images from the data directory. One sample data point in this file looks like:

{

"588174": "123276"

}

task_data.json

This file contains information about a task’s seed, aggregate, and parent task. One sample data point in this file looks like:

{

"1415863": {

"seed": ,

"parent": 1415862,

"aggregate":

}

}

POST 2.0/tasks/:id/submit

Submit a validation for a task. The validation is used to calculate a consensus of the segments that belong to the task. The validation will be analyzed for accuracy and given a suggested score.

| Name | Description |

|---|---|

| id | task id |

| access_token | … |

| status | one of finished, aborted, or training |

| segments | comma separated list of segment ids |

| reap (optional) | is this task submission a reap? |

Response 200

| Name | Description |

|---|---|

| score | suggested score |

| accuracy | estimated accuracy |

| trailblazer | was the submission one of the first validations for a task |

| special | ‘scythe’, ‘reaped’, null |

Example Response

{

"score": 60,

"accuracy": 0.5983492834,

"trailblazer": false,

"special": null

}

Data

GET data.eyewire.org/volume/$volumeID/chunk/0/$x/$y/$z/tile/$slicing/$from:$to

This method allows users to retrieve a set of 128×128 sized images (tiles) of the specified chunk in the specified volume.

| Name | Description |

|---|---|

| volumeID | volume id |

| x, y, z | chunk coordinates |

| from:to | the response includes tiles starting at the from layer up to but not including the to layer |

Response 200

An array of

| Name | Description |

|---|---|

| data | a base64 encoded jpeg for channel volumes or base 64 encoded png for segmentation volumes |

| view | id correlating to a plane, 1: XY plane, 2: XZ plane, 3: ZY plane |

| bounds |

Example Response

[

{

"data": "data:image/jpeg;base64,/9j/4A...",

"view": 1,

"bounds": {

"min": {

"x": 2930,

"y": 4082,

"z": 6482

},

"max": {

"x": 3186,

"y": 4338,

"z": 6738

}

}

},

...

]

Notes:

The returned Base64 strings contain line breaks (see RFC 2045). If your decoder has problems with those, you might want to strip them before decoding.

GET data.eyewire.org/volume/$volumeID/chunk/0/$x/$y/$z/mesh/$segmentID

This method allows users to retrieve the 3D model of a specified segment in the specified EyeWire chunk.

Response

Sends back a pure binary representation of a degenerated triangle strip containing interleaved vertex positions and vertex normals.

Degenerated triangle strip because some triangles collapse to lines on purpose, since it is impossible to describe some meshs with only one triangle strip.

If the mesh does not exist, the response is just empty.

Example Response

-

All values are Little Endian, 4 Byte .

-

v1 is the first vertex coordinate.

-

vn1 is the first vertex normal.

-

A vertex consists of three representing its X,Y,Z coordinates, in the given order.

-

Vertex Coordinates are within the range

-

Vertex Normals are normalized.

-

TIP: There were reported cases of corrupt meshes, appearing to be invisible. You can identify them by looking for meshes where all vertex coordinates have values .

Case Study Overview

![]()

EyeWire: a game to map the brain. Credit: Seung Lab.

The human brain has roughly 80 billion neurons connected with millions of miles of axons and dendrites. So it’s no surprise that neuroscientists are only just starting to understand how the brain is wired.

Neurons are miniscule, so researchers are utilizing a new imaging technique to map their connectivity. Even so, it takes a neuroscientist tens of hours to reconstruct a single cell.

To accelerate the pace of neuroscience, Seung Lab, formerly at the Massachusetts Institute of Technology and now at Princeton University, created EyeWire to crowdsource data analysis of brain neurons using an online game. EyeWire utilizes something more intelligent than even the most powerful supercomputer — the human brain. People can still do many things better than computers, including recognizing patterns. Capitalizing on this ability, an interdisciplinary team of scientists, developers and designers are turning EyeWire into a gaming platform to map the brain.

Download this case study (PDF, 118KB)

Website: EyeWire

Playing EyeWire (interacting with the dataset)

When a user plays EyeWire they see the images and a 3D representation of a part of the current they are attempting to map. This part is located inside a specific and (think of it like an address). The starting point of the part the user is mapping is called a . There may be multiple when a user begins mapping.

Providing the user with for a is called assigning the player a . As the user maps, they select they believe are attached to the . When the user is done mapping the , the the user selected are added to the task and create a .

-

- a with

- associated with a

-

- a neuron

- a tree structure consisting of several

- the root is usually part of the cell body

-

- the pre-highlighted visible when a player begins a task

- players select to group them with the

-

:

- a group of connected voxels that the EyeWire AI determined as belonging to a single branch of a cell

- each has a unique identifier for its containing

-

- a with a list of additional

- for example, a user starts playing EyeWire and receives a . The user then highlights s/he believes are part of the that the initial are part of. The resulting is returned as a

Solutions

Downsample Images

Segmentations of volumes are downsampled to a size of 64x64x64 by taking the max segment count in each subvolume of 4x4x4. This causes some tasks to not have any segments in the seed, so we have to remove those tasks.

Images are downsampled by taking the mean of each 4x4x4 block. This is done using skimage’s downsample_local_mean function.

Using asyncio and multiprocessing

Processing large amounts of data sequentially is extremely time consuming especially with the additional cost of HTTP requests. To combat that, we have to run parallel processes using python’s asyncio and multiprocessing libraries.

Asyncio skeleton code

def func_(*args):

# do things

return result

async def func(list, *args):

loop = asyncio.get_event_loop()

futures =

results =

for result in results:

#do things

pass

if __name__ == "__main__":

list =

loop = asyncio.get_event_loop()

loop.run_until_complete(func(list))

Multiprocessing skeleton code

def func_(val): # do things time.sleep(n) return result list = with multiprocessing.Pool(np) as p: results = list(tqdm.tqdm(p.imap(func, list), total=len(list))

The asyncio is not controllable, so it is difficult to throttle the speed. Since the Eyewire API is connected to the game, HTTP requests slow down the game and data collection. This is when multiprocessing is a better alternative to asyncio. Asyncio and multiprocessing were used in the data gathering step and preprocessing steps.

tqdm is a library that displays pretty progress bars. I highly recommend it for any script dealing with large loops.

Описание

Игра была создана лабораторией Себастьяна Сына в Массачусетском технологическом институте . Этот гражданин наука игра бросает вызов игрокам , чтобы создать 3D — карту нейронов внутри сетчатки . Eyewire был официально запущен 10 декабря 2012 года, и с тех пор в нем приняли участие более 200 000 игроков из 150 разных стран. Игра проводится Wired Differently на некоммерческой основе в партнерстве с лабораторией Сына в Принстонском университете и данными, полученными Институтом медицинских исследований Макса Планка .

EyeWire способствует развитию нейробиологии , помогая исследователям обнаружить, как нейроны соединяются и обрабатывают визуальную информацию. Anyone, Anywhere может помочь ученым разработать искусственный интеллект и вычислительные технологии для отображения коннектома . В Eyewire игрокам предстоит решать трехмерные головоломки. Эти головоломки фактически действуют как реконструкция трехмерных моделей нейронов с наноразмерным разрешением, сделанных из изображений, полученных с помощью электронной микроскопии. Для игры Eyewire не требуется никакой научной подготовки. Лучше всего он работает при быстром подключении к Интернету, поскольку есть много микроскопических изображений.

Eyewire был представлен WIRED, Nature, Forbes, Scientific American и NPR.

Ссылки [ править ]

- ^ «5 лет Eyewire» . Blog.eyewire.org . 7 декабря 2017 . Проверено 31 января 2018 года .

- ^ a b «О << Eyewire» . Архивировано из оригинального 13 февраля 2012 года . Проверено 17 апреля 2014 года .

- ^ Ким, Jinseop S; Грин, Мэтью Дж; Златески, Александар; Ли, Кисук; Ричардсон, Марк; Турага, Шринивас К.; Пуркаро, Майкл; Балкам, Мэтью; Робинсон, Эми; Бехабади, Бардиа Ф; Кампос, Майкл; Денк, Винфрид; Сын, Х. Себастьян (2014). «Пространственно-временная разводка поддерживает избирательность направления в сетчатке» . Природа . 509 (7500): 331–336. Bibcode2014Natur.509..331. . DOI10,1038 / природа13240 . PMC 4074887 . PMID 24805243 .

- ^ Тинати, Рамине; Лучак-Рош, Маркус; Симперл, Елена; Шедболт, Найджел; Холл, Венди (2015). » ‘ / Command’ и Conquer: Анализ Обсуждение в Citizen Science Game» . Материалы конференции ACM Web Science по ZZZ — Web Sci ’15 . п. 26. DOI10,1145 / 2786451,2786455 . ISBN 978-1-4503-3672-7.

- ^ «О Eyewire, игра для отображения мозга» . Blog.eyewire.org . 6 ноября 2012 . Проверено 31 января 2018 года .

- ^ «Нейронные сети: теория и приложения» . Seunglab.org . Архивировано из оригинала на 2018-01-30 . Проверено 29 января 2018 .

- ^ «Retina << Eyewire» . Архивировано из оригинального 24 марта 2012 года . Проверено 27 марта 2012 года .

- ^ «Eyewire» . Проверено 27 марта 2012 года .

- ^ «Музей | Очки» . Museum.eyewire.org . Проверено 20 марта 2018 .

- ^ «Challenge << Eyewire» . Архивировано из оригинального 14 апреля 2012 года . Проверено 27 марта 2012 года .

-

↑ Себастьян Сын (18 марта 2012 г.). «Очень маленькие участки нейрона» . Архивировано из оригинального 19 апреля 2014 года . Проверено 27 марта 2012 года .

Еще несколько слов для объяснения любопытных … вы окрашиваете нейроны на Eyewire, управляя искусственным интеллектом (AI).

ИИ был обучен окрашивать ветви нейронов.

- ^ «Архивная копия» . Архивировано из оригинала на 2014-04-18 . Проверено 17 апреля 2014 .

- ^ «Да, это командир Крис Хэдфилд в Oculus Rift. (И да, Интернет просто взорвался.)» . Blog.ted.com . 26 марта 2014 . Проверено 31 января 2018 года .

- ^ «Фестиваль науки и инженерии США — крупнейший научный фестиваль в стране» . USASEF . Проверено 31 января 2018 года .

- ^ «Наука: Объявлены победители конкурса 2013 International Science and Engineering Visualization Challenge» . Aaas.org . 5 февраля 2014 . Проверено 31 января 2018 года .

- ^ «Архивная копия» . Архивировано из оригинала на 2016-05-06 . Проверено 17 апреля 2014 .

- ^ «Наука для людей, людьми» . DiscoverMagazine.com . Проверено 31 января 2018 года .

- ^ «13 лучших гражданских научных проектов 2013 года» . SciStarter.com . 1 января 2014 г.

- ^ «Архивная копия» . Архивировано из оригинала на 2014-04-19 . Проверено 17 апреля 2014 .

- ^ «Лучшие проекты в области гражданской науки 2012 года — CitizenSci» . Blogs.plos.org . 31 декабря 2012 г.

- ↑ Стинсон, Лиз (2 августа 2013 г.). «Видеоигра, которая набирает игроков, чтобы составить карту мозга» . Проводной . Проверено 10 ноября 2019 .

- ^ SpotOn Editor (14 марта 2013). «SpotOn NYC: Коммуникация и мозг — игра для отображения мозга» . SpotOn (блог). Природа . Архивировано из оригинального 18 марта 2013 года . Проверено 10 ноября 2019 .

- ^ Франк, Аарон; с Вивеком Вадхвой (19 августа 2013 г.). «Более 70 000 человек сыграли в игру« Eyewire », которая обучает компьютеры отображать мозг» . Forbes . Проверено 10 ноября 2019 .

- ^ «Обновление: EyeWire» . Scientific American . 13 июня 2014 . Проверено 17 апреля 2014 года .

- ^ Palca, Джо (5 марта 2013). «Хочешь поиграть? Компьютерные геймеры помогают расширить границы исследований мозга» . Большая идея Джо. Утреннее издание . NPR . Проверено 10 ноября 2019 .

Как играть

EyeWire предлагает игрокам воспроизвести трехмерную нейронную карту. После регистрации игроки автоматически проходят обучение, объясняющее игру. Дополнительные видеоуроки доступны в блоге.

В EyeWire игрок смотрит на куб, часть которого воссоздана в 3D слева. В правой части экрана черно-белое изображение представляет электронную микроскопию. Таким образом, игрок учится шаг за шагом раскрашивать нейроны, чтобы сформировать единую ветвь нейронов, последовательно передавая электронные изображения; ветвь появляется в 3D.

Затем карты сравниваются друг с другом для опытных игроков и администраторов, чтобы проверить работу сообщества. Эти более опытные игроки могут расширять ветви и удалять ошибочные сегменты.

Подробные инструкции

Задача игрока — выбрать области, которые искусственный интеллект пропустил бы, улучшив таким образом расположение и форму нейрона. Некоторые обновления могут просто заполнить пробелы. Другие могут расширить одну ветку, а другие могут найти новые ветки, которые упустил искусственный интеллект. В интерфейсе трехмерное изображение показывает след нейрона через объем, в то время как игрок может прокручивать вверх и вниз в обоих измерениях, чтобы взглянуть на микроскопические изображения. Игрок нажимает на эти изображения, чтобы добавить их к фигуре. ИИ автоматически заполняет части нейрона, которые он обнаруживает при нажатии на область. Как только игрок выполнил свою задачу, она отправляется на проверку, и появляется другая задача.

Счет

Каждый том предоставляется от трех до пяти разных игроков, и макет, выбранный большинством игроков, принимается. Все предлагаемые новые ветки могут привести к исследованию новых объемов. Игрокам начисляются очки в зависимости от их раскладки, если она соответствует большинству других игроков.

Вместо заключения

Это может быть интересно

![]()

Новости каждый день: психология информационной эпохи

Нейронауки — область исследования, в которой новые открытия совершаются буквально каждый день. Подходов, которые остались за пределами этого текста, очень много. Например, вот Ларри Суонсон (Larry Swanson), профессор из USC Dornsife College of Letters, Arts and Sciences, проанализировал данные исследований за 40 лет и пришёл к выводу, что мозг крыс устроен и работает аналогично Всемирной паутине — с локальными сетями и хабами, которые вливаются в единую большую магистраль.

Когда-нибудь мы накопим критическую массу таких исследований, и случится то, что постоянно случается в науке. Из обрывков точечного знания сложится большой прорыв в понимании того, что происходит у нас в голове.

Conclusion

In this project we introduce a lightweight U-Net that can be used on smaller 3D images. We also introduce the concept of Bayesian Deep Learning, which allows us to calculate the model’s uncertainty. Using Bayesian Deep Learning on our lwunet, we manage to create a model that is able to propagate the seed of tasks in Eyewire to match as close as possible the trace of the neuron designated by the seed. We also realize how many mergers the current Eyewire segmentation algorithm actually creates, as removing them shows that lwunet appears to be less precise with its guesses. We also get confirmation that black spills cause lots of confusion in not only humans, but the model too.

There is a nontrivial mismatch between how this model creates output and how Eyewire actually plays, so automation attempts will have to do additional research on how to convert downsampled images to the segments displayed in Eyewire.

Когнитом и коги

Нельзя не рассказать о самом перспективном направлении исследования психики человека, к которому приложил руку наш соотечественник Константин Анохин — внук легендарного советского физиолога Петра Кузьмича Анохина (создателя теории функциональных систем).

Как известно, главной задачей нейронаук является понимание того, как из работы материальных и доступных изучению приборами элементов нервной системы получается неуловимая работа психики. Создание сетевых моделей формальных элементов мозга (когнитома) — всего лишь один из этапов. Для понимания того, как из работы отдельных нейронов и их групп получается, например, воспоминание, придётся выработать совершенно новую теоретическую основу.

Первый набросок такой «теории разума» и предлагает Константин Анохин. Для её понимания он вводит новый термин «ког» — элемент психического опыта, связанный с работой какого-то участка нейронной сети. Из множества связанных друг с другом когов строится когнитом — сеть психики, внутренний мир животного или человека, которому принадлежит данная нейронная сеть.

https://youtube.com/watch?v=UKw_4ERm408

Как описывают связи в мозге?

Для создания карт нейронных связей используются послойные снимки электронных микроскопов, которые сравниваются между собой вручную. На основе этих снимков создаются модели нейронов и связей между ними.

Здесь обязательно нужно рассказать об уже легендарном проекте EyeWire, в рамках которого усилиями сотен тысяч интернет-пользователей на примере сетчатки человека обучается искусственный интеллект, который в будущем сможет автоматически анализировать миллионы микроскопических срезов нервной ткани. Этот проект — дитя сотрудничества двух институтов — Массачусетского технологического института и Института медицинских исследований имени Макса Планка.

Автор проекта — бывший физик Себастьян Сеунг (Sebastian Seung), который сегодня работает в Принстонском университете, возглавляя там проект по анализу коннектома дрозофилы. Когда-то он оставил перспективную работу в Кембридже и уехал в Германию, чтобы заняться созданием системы искусственного интеллекта, способной создавать из двухмерных изображений гистологических срезов трёхмерные модели различных микрообъектов.

Следующим этапом было выведение этой системы в интернет (в виде онлайн-игры) и использование краудсорсинговой мощи для обучения системы и исправления ошибок автоматического распознавания. Проект стартовал в 2012 году и уже успел стать культовым. С его помощью созданы полные трехмерные модели примерно трёхсот нейронов человеческой сетчатки. Общее число онлайн-игроков в EyeWire сегодня уже превышает 180 тысяч человек из 150 стран мира, и каждый день к игре подключаются новые и новые участники.

После создания карты трёхмерных моделей нейронов авторы проекта собираются провести картирование всех синаптических контактов сетчатки. Объёмы предстоящей работы настолько масштабны, что полный анализ срезов человеческого мозга (путь от 300 нейронов до 140 миллиардов) займёт, по разным оценкам, от четырёх до пяти десятков лет. С другой стороны, всё ещё остается надежда, что алгоритмы автоматического распознавания усовершенствуются настолько, что на долю человека останется не так уж много работы.

Если так произойдёт, полную карту человеческого коннектома мы увидим уже в конце двадцатых–начале тридцатых годов нынешнего столетия.

Обзор достижений коннектомики и описание проекта EyeWire в TED-лекции создателя проекта Себастьяна Сеунга

У проекта EyeWire есть важное преимущество. Состоит оно в том, что для участия в нём не нужно быть биологом

С задачкой «найди недостающий участок картинки» справится даже ребенок. Сам проект не требует установки на компьютер специального софта и реализован прямо в браузере. Раcскажем о нём чуть подробнее.

POST 2.0/tasks/assign

Assigns a task to a user. You may optionally request that the task belongs to a specific cell.

Request

| Name | Description |

|---|---|

| access_token | token that allows calling the api as a specific user |

| cell_id (optional) | the returned task will belong to the specified cell. |

Response 200

The response contains volume objects that contain ids and bounds which are used to access .

| Name | Description |

|---|---|

| id | task id |

| seeds | array of segment ids known to be part of the cell. |

| cell_id` | the ID of the cell that the task belongs to |

| channel_id | id |

| segmentation_id | id |

Example Response

{

"id": 17444,

"seeds": ,

"cell": 10,

"channel_id": 63200,

"segmentation_id": 63201,

"bounds": {

"min": {

"x": 2930,

"y": 4082,

"z": 6482

},

"max": {

"x": 3186,

"y": 4338,

"z": 6738

}

}

}

Анатомия EyeWire

Это может быть интересно

![]()

Дети и гаджеты: что делать родителям и учителям

Для работы сайта идеально подходит браузер Chrome. Чтобы не было проблем при воспроизведении трёхмерной модели нейрона, нужно включить в настройках браузера поддержку WebGL (технологию аппаратного ускорения трехмерной графики) — сайт вам любезно сообщит, если поддержка у вас отключена.

Внутри EyeWired каждый нейрон разбивается на микроразмерные «кубики» ткани, содержимое которых послойно анализируется искусственным интеллектом и добровольцами. Первое, что видит свежезарегистрированный участник проекта — два окошка. В левом находится модель анализируемого фрагмента нейрона, а в правом — набор микросрезов, на основе которых и составляется это трехмерное изображение.

![]()

Каждому игроку достается куб с частично реконструированными ветвями модели нейрона. Цель игры состоит в том, чтобы максимально точно указать принадлежащие изучаемому нейрону фрагменты микрофотографий в правом окне. По сути это уточнение результатов работы, которую предварительно проделал искусственный интеллект.

Поскольку игроков в игре множество, один и тот же кубик распознается многократно, а итоговая модель кусочка нейрона внутри него определяется итогом работы каждого участника игры. Упущения одних при таком подходе компенсируются находками других, что делает итоговую модель очень точной: в EyeWired можно играть, не боясь ошибиться — на научном результате ошибки отдельных игроков не отразятся.

![]()

По мере продвижения вперед растёт опыт игрока и результативность распознавания микросрезов. Участники получают очки в зависимости от объёма сделанной работы и соревнуются между собой.

Нейроны анализируются по очереди, и на главной страничке сайта всегда видна клетка, над которой идёт работа сообщества в данный момент. Все участники игры могут посмотреть на место распознанных ими фрагментов в общей картине.

![]()

Хотя русской версии сайта пока нет, наглядно поможет сориентироваться в несложном интерфейсе серия видеомануалов на YouTube-канале проекта. Также есть вики-справочник по проекту EyeWiki.

![Eyewireсодержание а также геймплей [ править ]](http://mediaex.ru/wp-content/uploads/8/8/4/884430d477fcd78c80eebee1a9ec8c5e.jpeg)